[AI요약] 기술 기업들이 엔비디아의 의존도를 줄이기 위해 자체 AI 칩을 개발하려는 움직임 속에서 엔비디아가 ‘AI 버블’에 대한 질문에 답했다. 엔비디아가 공개한 AI 데이터 센터를 위한 새로운 컴퓨팅 플랫폼인 베라 루빈은 업계 상당한 영향을 미칠 것으로 보인다. AI가 더욱 정교해지고 여러 단계를 거치는 과정 속 ‘추론’하는 능력이 향상됨에 따라 기존 방식으로는 더 이상 충분하지 않았던 부분에서 베라 루빈이 제 역할을 할 것으로 기대되고 있다.

글로벌 AI 칩 선두주자 엔비디아가 인공지능 추론 성능을 획기적으로 끌어올린 차세대 컴퓨팅 플랫폼을 세상에 내놨다.

젠슨 황 엔비디아 최고경영자(CEO)는 5일(현지시간) 미국 네바다주 라스베이거스 CES 2026 행사장에서 특별 연설을 갖고, 신규 AI 플랫폼 '베라 루빈(Vera Rubin)'의 상세 사양과 출시 계획을 밝혔다. 버지와 CNN 등 주요 외신들이 일제히 보도했다.

이번 발표가 업계의 이목을 끈 이유는 명확하다. 엔비디아 기술에 크게 의존하고 있는 글로벌 빅테크 기업들의 AI 전략에 직접적 영향을 미칠 핵심 인프라이기 때문이다.

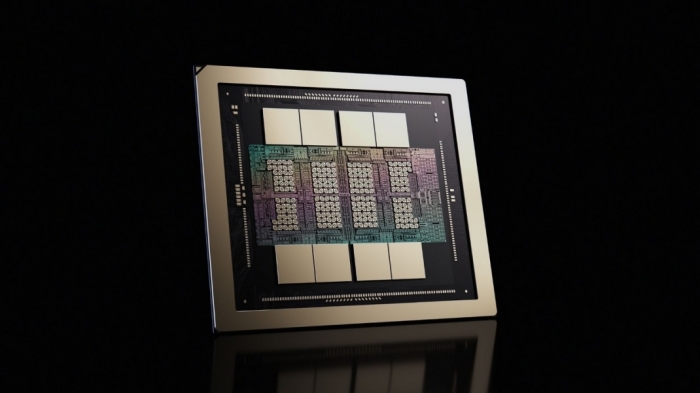

베라 루빈은 엔비디아가 자체 개발한 CPU '베라'와 최신 GPU '루빈'을 하나로 묶은 통합 솔루션이다. 천문학자 베라 플로렌스 쿠퍼 루빈의 이름을 따왔으며, 기존 '그레이스 블랙웰' 아키텍처의 진화형에 해당한다.

엔비디아는 이미 지난해 말 베라 루빈 존재를 암시한 바 있지만, CES 현장에서 시스템 구조와 양산 일정 등 구체적 로드맵을 처음으로 확정 발표했다. 엔비디아 측은 베라 루빈이 현재 대량 생산(full production) 체제에 진입했으며, 올해 하반기부터 클라우드 파트너사들을 통해 고객에게 공급된다고 밝혔다.

엔비디아는 작년 시가총액 5조 달러(약 7240조원)를 잠시나마 돌파하며 AI 붐의 최대 수혜자로 떠올랐다. 하지만 최근 들어 빅테크 기업들이 자체 AI 칩 개발에 나서면서 엔비디아 의존도를 낮추려는 움직임이 감지되고 있고, 'AI 거품' 논란도 수면 위로 부상한 상태다.

이런 시점에 젠슨 황 CEO는 의미심장한 답변을 내놨다. 그는 "기업들이 AI에 쏟아붓는 자금은 사실 기존 전통 컴퓨팅 R&D 예산을 전환한 것"이라며 AI 버블 우려에 정면 반박했다.

베라 루빈 플랫폼이 등장한 배경에는 AI 모델의 복잡도가 급격히 높아지는 트렌드가 자리 잡고 있다. 과거처럼 단순한 질의응답 수준을 넘어, 여러 단계를 거치며 '생각'하는 AI로 진화하려면 기존 인프라로는 한계에 부딪힐 수밖에 없다는 게 엔비디아의 판단이다.

기존 GPU 중심의 메모리·스토리지 구조로는 구글, 오픈AI, 앤스로픽 같은 AI 선도 기업들이 구상하는 '본격 AI 비서' 수준의 서비스를 뒷받침하기 어렵다는 것이다.

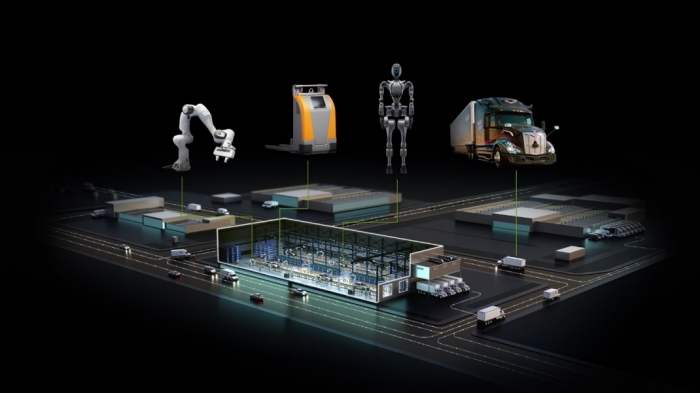

젠슨 황 CEO는 기조연설에서 챗봇에서 에이전트로의 전환을 강조하며 큰 반향을 일으켰다. 시연 영상에서는 사람이 작은 탁상 로봇을 엔비디아 DGX 스파크 데스크톱 컴퓨터에 연결해, 여러 AI 모델을 조합하여 개인 비서를 구현하는 장면이 공개됐다. 이 로봇은 사용자의 일정을 상기시켜주거나 심지어 애완견에게 소파에서 내려오라고 지시하는 등 실생활에 밀착된 작업을 수행했다.

황 CEO는 "불과 몇 년 전만 해도 꿈도 꾸지 못했던 일"이라며 "하지만 이제는 개발자들이 전통적 코딩 대신 거대 언어 모델(LLM)을 활용해 애플리케이션을 만들 수 있게 되면서 '놀라울 정도로 간단해졌다'"고 설명했다.

즉 AI가 여러 과정을 거쳐 최종 답을 도출하는 '추론 능력'이 강화되면서, 과거 방식으로는 더 이상 감당이 안 된다는 게 핵심 메시지다.

엔비디아는 CES를 앞두고 추론 전문 스타트업 그록(Groq)과 라이선스 계약을 맺기도 했다. 업계에서는 엔비디아가 AI 추론 분야에 막대한 베팅을 하고 있다는 신호로 받아들이고 있다.

올해 베라 루빈을 가장 먼저 도입할 클라우드 사업자로는 마이크로소프트, 아마존웹서비스(AWS), 구글 클라우드, 오라클 클라우드 인프라, 코어위브, 람다, 네비우스, 엔스케일 등이 거론됐다.

특히 마이크로소프트는 차세대 AI 데이터센터 구축의 일환으로, 향후 페어워터(Fairwater) AI 슈퍼팩토리 부지를 비롯한 여러 시설에 베라 루빈 NVL72 시스템을 대규모로 설치할 계획이다.

델, 시스코 등 서버·네트워크 장비 제조사들도 자사 데이터센터 솔루션에 신규 칩을 통합할 것으로 예상된다. 오픈AI, 앤스로픽, 메타, xAI 같은 AI 스타트업과 빅테크들도 베라 루빈을 활용해 한층 정교한 서비스를 구현할 것으로 전망된다.

황 CEO는 AI 모델이 결론에 도달하기까지 여러 단계를 거치며 '숙고'하는 과정에 주목했다. 그는 "추론은 더 이상 즉각적인 한 줄 답변이 아니다. 생각의 흐름 전체가 추론"이라고 정의했다.

디온 해리스 엔비디아 고성능 컴퓨팅·AI 하이퍼스케일 솔루션 담당 수석 이사는 "과거에는 연산 속도가 병목이었다면, 이제는 맥락(context) 관리가 진짜 병목"이라며 "스토리지를 더 이상 부수적 요소로 봐서는 안 된다"고 강조했다.

그는 또 "차세대 AI 서버 랙인 베라 루빈 NVL72는 인터넷 전체보다 많은 대역폭을 제공한다"고 덧붙였다.

엔비디아는 베라 루빈을 통해 AI 모델의 추론 토큰당 비용을 이전 블랙웰 플랫폼 대비 10분의 1 수준으로 낮추고, 전문가혼합모델(MoE) 학습에 필요한 GPU 개수도 4분의 1로 줄일 수 있다고 설명했다.

업계에서는 베라 루빈이 AI 대중화를 가속하는 핵심 인프라로 자리매김할 것으로 보고 있다. 높아지는 AI 연산 수요를 효율적으로 해결하면서도 비용을 대폭 낮출 수 있다면, 더 많은 기업과 개발자들이 AI 서비스를 시도할 수 있기 때문이다.