AI 경량화·최적화 기술 기업 노타는 업스테이지의 대형언어모델(LLM) ‘솔라 오픈 100B’에 자사 차세대 양자화 기술을 적용해 메모리 사용량을 대폭 낮추는 데 성공했다고 5일 밝혔다. 초대형 모델 운용의 핵심 부담인 메모리와 추론 비용을 줄이면서도 성능 저하는 최소화했다는 점에서, 온디바이스 AI와 피지컬 AI 시장에서의 활용 가능성을 한층 넓혔다는 평가가 나온다.

이번 성과의 핵심은 MoE(Mixture of Experts) 구조에 맞춘 독자 양자화 기술이다. 최근 고성능 LLM에서 널리 쓰이는 MoE 구조는 여러 전문가 모델이 입력에 따라 선택적으로 작동하는 방식이지만, 기존 양자화 기법으로는 각 전문가 모델의 특성을 충분히 반영하기 어려웠다. 모델 전체를 일괄적으로 압축하는 방식이 주류였던 탓에, 메모리를 줄이는 대신 성능 훼손이 커지는 한계가 있었다.

노타는 이런 문제를 해결하기 위해 전문가 모델별 특성을 고려한 ‘노타 MoE 양자화’ 방법론을 개발했다. 모든 연산을 같은 수준으로 줄이는 대신, 정밀도가 필요한 부분은 유지하고 상대적으로 영향이 적은 부분만 압축하는 방식이다. 회사는 이를 통해 MoE 모델 추론 과정에서 발생하는 왜곡을 줄이고, 경량화와 성능 유지 사이의 균형을 끌어올렸다고 설명했다.

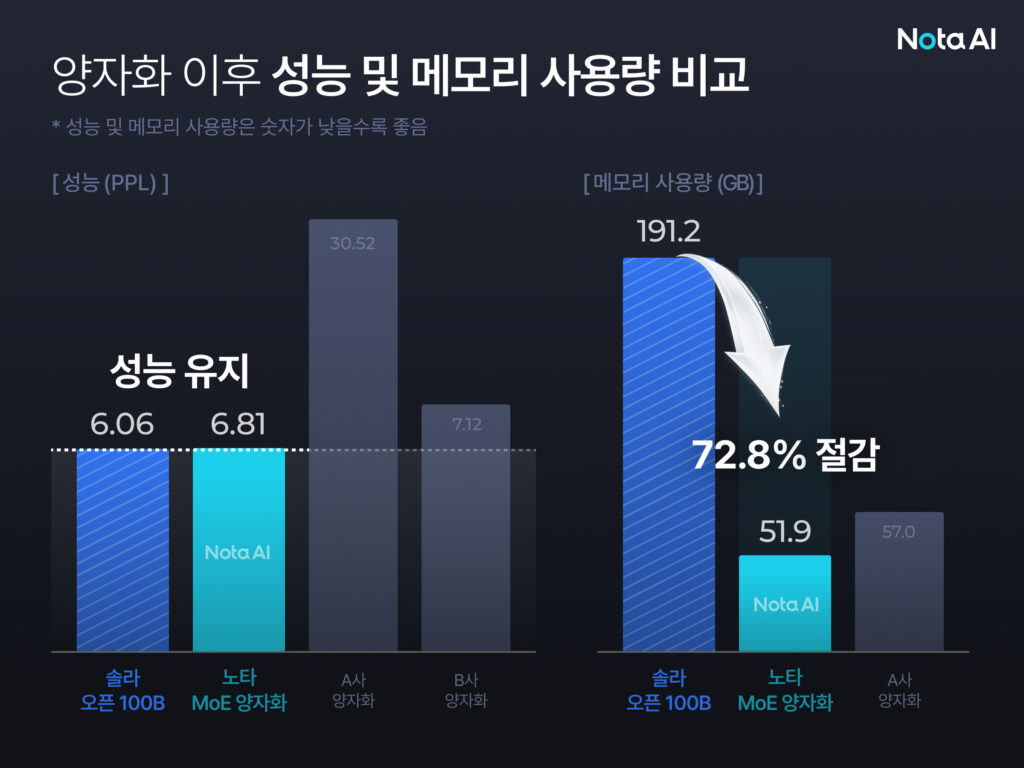

실제 적용 결과도 수치로 제시됐다. 노타 기술이 적용된 솔라 100B는 기존 191.2GB 수준이던 메모리 사용량을 51.9GB까지 낮췄다. 약 72.8% 줄인 셈이다. 동시에 성능 지표인 퍼플렉시티(PPL)는 6.81로, 원본 모델 6.06에 근접한 수준을 유지했다. 단순 압축만으로는 성능 저하가 크게 나타나던 기존 범용 양자화 기법과 비교하면, 메모리 효율과 성능 보존을 함께 잡은 결과에 가깝다.

이번 기술은 과학기술정보통신부가 추진하는 ‘독자 AI 파운데이션 모델 프로젝트’의 일환으로 진행됐다. 업스테이지의 솔라 오픈 100B에 노타의 경량화 기술을 입히는 방식으로, 한국형 대형 AI 모델의 실사용 가능성을 높이는 데 초점이 맞춰졌다. 회사는 관련 기술에 대해 특허도 출원했다.

의미는 분명하다. 초대형 LLM은 높은 성능에도 불구하고 메모리 요구량과 GPU 인프라 비용이 커 실제 산업 현장 적용에 제약이 많았다. 특히 로봇, 자동차, 모빌리티처럼 디바이스 안에서 직접 AI를 구동해야 하는 피지컬 AI 환경에서는 더 큰 장벽으로 작용했다. 노타는 이번 기술로 이 장벽을 낮춰, 대규모 언어모델을 보다 적은 인프라에서 빠르게 운용할 수 있는 기반을 마련했다고 보고 있다.

기업 입장에서도 효과는 직접적이다. 같은 하드웨어 자원으로 더 많은 사용자를 처리할 수 있고, 기존에는 탑재가 쉽지 않았던 대용량 모델을 디바이스 환경에 구현할 가능성도 커진다. 결국 추론 비용 절감과 서비스 응답 속도 개선, 운영 효율 향상으로 이어질 수 있다는 얘기다.

채명수 노타 대표는 “이번 성과는 한국형 AI 파운데이션 모델인 솔라 100B에 노타의 양자화 기술을 적용해 메모리를 크게 줄이면서도 성능을 유지했다는 점에서 의미가 크다”며 “디바이스에 대규모 모델을 구현해야 하는 수요가 확대될수록, 노타의 경량화·최적화 기술이 고성능 AI 실현의 핵심 역할을 하게 될 것”이라고 말했다.