알리바바 그룹의 디지털 기술 및 인텔리전스 중추인 알리바바 클라우드가 31일 자사 큐원(Qwen) 시리즈의 통합 엔드투엔드(end-to-end) 멀티모달 모델인 ‘Qwen2.5-Omni-7B’를 새롭게 공개했다.

알리바바 클라우드에 따르면 이번 모델은 종합적인 멀티모달 인식을 위해 설계되어, 텍스트, 이미지, 음성, 영상 등 다양한 형태의 입력 정보를 처리하고 실시간 텍스트 및 자연스러운 음성 응답을 지원한다. 또 Qwen2.5-Omni-7B는 7B(70억) 파라미터의 컴팩트한 설계에도 불구하고 성능 저하 없이 강력한 멀티모달 처리 능력을 제공한다.

알리바바 클라우드 측은 “모바일 기기와 노트북과 같은 엣지 디바이스에 최적화된 멀티모달 AI 기술”이라며 “이러한 고유한 조합은 특히 지능형 음성 애플리케이션과 같이 실질적인 가치를 제공하는 민첩하고 비용 효율적인 AI 에이전트 개발에 적합하다”고 설명했다.

예를 들어 이 모델은 시각 장애인이 실시간 음성 설명을 통해 주변 환경을 인식하고 탐색할 수 있도록 지원하거나, 동영상 속 재료를 분석해 단계별 요리 가이드를 제공하는 데 활용될 수 있다. 또한 고객의 니즈를 정확히 이해하는 지능형 고객 응대 시스템 구현에도 적용 가능하다.

Qwen2.5-Omni-7B는 현재 허깅페이스(Hugging Face)와 깃허브(GitHub)를 통해 오픈소스로 공개되었으며, 큐원 챗(Qwen Chat)과 알리바바 클라우드 오픈소스 커뮤니티인 모델스코프(ModelScope)를 통해서도 접근할 수 있다. 알리바바 클라우드는 지난 몇 년간 총 200개 이상의 생성형 AI 모델을 오픈소스로 공개한 바 있다.

Qwen2.5-Omni-7B는 유사한 규모의 단일 모달리티(single-modality) 특화 모델과 비교해도 손색이 없다. 특히 실시간 음성 상호작용, 자연스럽고 안정적인 음성 생성, 엔드투엔드 음성 명령어 이행 등에서 주목할 만한 성능을 보이고 있다.

알리바바 클라우드 측은 “이러한 모델의 효율성과 고성능은 혁신적인 아키텍처에서 비롯된다”고 강조했다.

대표적으로 텍스트 생성(Thinker)과 음성 합성(Talker)을 분리하여 서로 다른 모달 간의 간섭을 최소화하는 ‘Thinker-Talker 아키텍처(Thinker-Talker Architecture)’; 일관된 콘텐츠 생성을 위해 비디오 입력과 오디오를 보다 잘 동기화하는 위치 임베딩(position imbedding) 기술 TMRoPE(Time-aligned Multimodal RoPE); 그리고 끊김 없는 음성 상호작용을 위한 저지연(low latency)오디오 응답을 가능하게 하는 블록와이즈 스트리밍 처리(Block-wise Streaming Processing) 등이 적용되었다.

이 외에도 Qwen2.5-Omni-7B는 이미지-텍스트, 영상-텍스트, 영상-음성, 음성-텍스트, 텍스트 데이터를 포함한 방대하고 다양한 데이터셋을 기반으로 사전 학습되어 다양한 작업에서 강력한 성능을 보장한다.

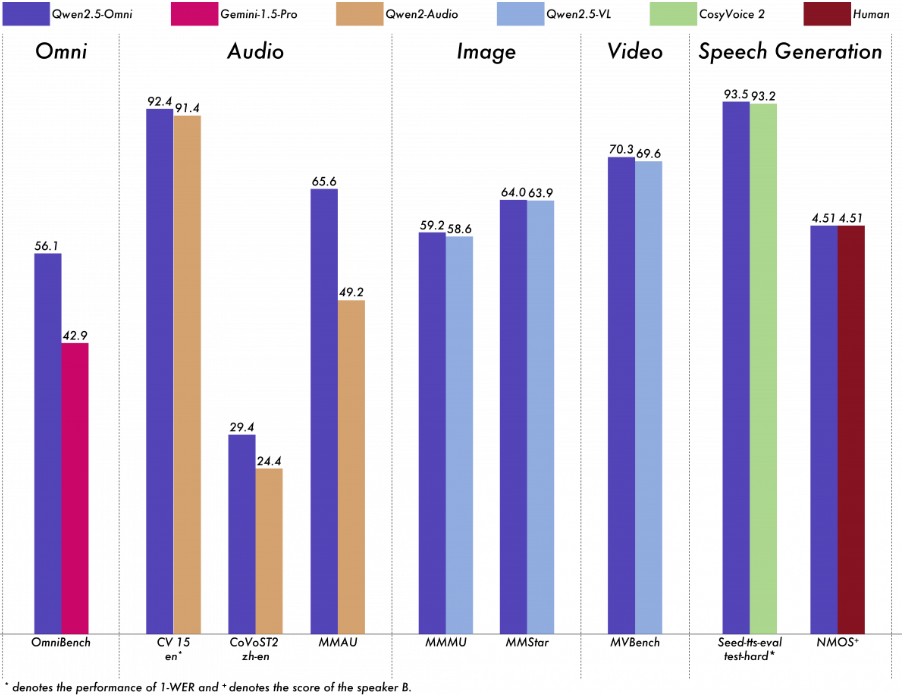

혁신적인 아키텍처와 고품질 사전학습 데이터셋을 바탕으로 이 모델은 음성 명령을 정확히 이해하고 수행하는 데 뛰어난 성능을 보이며, 텍스트 입력만 사용하는 경우와 유사한 수준의 성능을 달성한다. 특히 시각, 청각(acoustic), 텍스트 정보를 통합적으로 인식, 해석, 추론하는 능력을 평가하는 OmniBench 벤치마크와 같이 다양한 모달리티를 통합적으로 처리해야 하는 작업에서도 최고 수준의 성능을 기록했다는 것이 알라바바 클라우드 측의 설명이다.

한편 알리바바 클라우드는 지난해 9월 Qwen2.5를 처음 공개한 데 이어, 올해 1월에는 ‘Qwen2.5-Max’를 출시해 Chatbot Arena에서 7위를 기록, 대등한 주요 상용 모델들 대비 뛰어난 성능을 입증한 바 있다. 또한 시각 이해와 장문 입력 처리를 위한 모델인 ‘Qwen2.5-VL’과 ‘Qwen2.5-1M’ 등을 오픈소스로 공개했다.