지금까지 등장한 것 가운데 가장 뛰어난 피사계심도(depth of field)를 가진 카메라(광시야 카메라·light field camera)가 만들어졌다. 미국 과학자들이 렌즈로부터 3cm~1.7km 사이에 있는 피사체의 초점거리를 자유자재로 조절하며(피사체 상을 또렷하게 맺히게 하며) 초점을 맞출 수 있는 놀라운 광학 카메라 렌즈를 개발했다.

미국립표준기술원(NIST) 연구원들이 개발한 광시야 카메라는 지금까지 기록된 것 가운데 가장 깊은 피사계심도를 가진 카메라다. (*사진촬영 시 초점이 맞은 것으로 인식되는 범위다. 예를 들어, 시야의 심도가 얕으면 피사체가 또렷하게 유지되지만 전경과 배경의 많은 부분이 흐릿해진다)

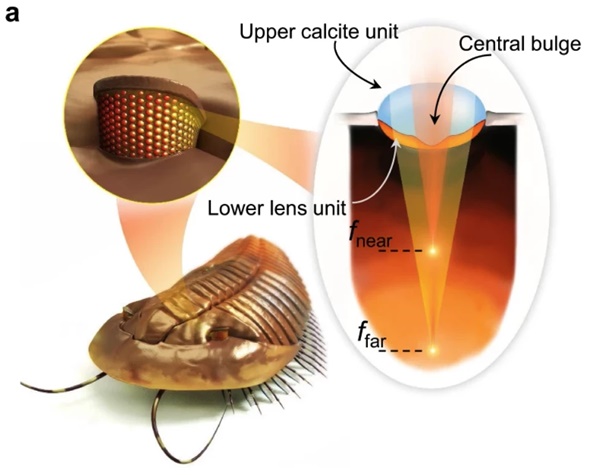

광시야 카메라의 개발의 배경은 놀랍게도 고대 삼엽충의 눈이었다. 삼엽충은 약 5억년 전에 지구의 바다를 뒤덮었던 생물이며, 오늘날 투구게의 먼 사촌이다.

이들의 시각 시스템은 매우 복잡했는데, 복합 눈을 포함해 수십에서 수천 개의 작은 독립된 단일체들을 특징으로 하며, 각각에 각막, 렌즈, 그리고 광수용체 세포를 가지고 있다. 연구원들은 여기서 영감을 얻었다.

삼엽충의 특이한 눈 구조···가까운 먹잇감·멀리서 오는 포식자 모두 본다

특히 삼엽충 가운데 한 종인 달마니티나 소시알리스(Dalmanitina socialis)는 독특한 복합 눈 구조 때문에 NIST 연구자들의 관심을 끌었다. 화석 기록 조사에 따르면 이 작은 곤충은 시각계 전반에 걸쳐 이중 층으로 된 렌즈를 가지고 있었다. 이는 오늘날의 어떤 절지동물(나비, 가재, 새우, 거미 등이 있다)의 눈과도 차별화된다.

그리고 이 삼엽층 이중 층 렌즈의 위쪽 층 중간에는 두 번째 초점을 만들어내는 돌출부가 있다. 이는 이 삼엽충이 바로 앞에 있는 먹잇감과 더 먼 곳에서 다가오는 적들(포식자들)에게 초점을 맞출 수 있었다는 것을 의미한다.

통상적으로 물체가 렌즈의 초점거리보다 더 가까이, 또는 더 멀리 있다면 상이 흐려져서 분해능과 색상 대비가 나빠진다. 따라서 삼엽충이 이처럼 가까이부터, 멀리서까지 피사계 심도를 자유자재로 잘 조절한다면 생존에 크게 도움이 된다.

삼엽충의 이중 층 눈 구조를 본뜨다

연구팀은 이같은 삼엽충 눈의 얼개에 기반한 아이디어를 광시야 카메라에 적용해 보고자 했다.

일반 카메라가 기본적으로 빛을 받아들여 2차원 그리드에 걸쳐 색상 및 휘도 정보를 기록하는 반면, 광시야 카메라는 색과 휘도뿐만 아니라 센서로 들어오는 각 광선의 방향까지 계산하기에 훨씬 더 복잡하다.

그러나 삼엽충의 이중 층 방식으로 전체 광시야가 포착되면 색상, 깊이, 투명도, 특이도, 굴절 및 흡장(occlusionm·그림자를 더해주는 기술) 측면에서 장면을 재구성할 수 있는 충분한 정보를 얻을 수 있다. 게다가 사진이 촬영되면 초점, 피사계 심도, 기울기 및 투시 이동과 같은 것들도 조정할 수 있다.

NIST 팀에 따르면 기존 카메라 렌즈는 공간 분해능이나 색상 정보을 잃지 않고 피사계심도를 확장하거나, 또는 조리개를 너무 많이 조이면서 셔터 스피드의 문제를 일으켰다. 이들은 바로 이 부분에서 삼엽충의 이중 층 눈 렌즈 원리를 이용해 문제 해결의 영감을 얻었다.

삼엽충의 눈처럼 보게 되다

실마리를 찾은 연구원들은 이 놀라운 렌즈 제작에 들어갔다.

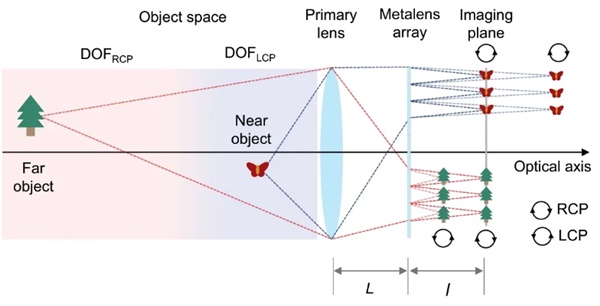

이들은 작은 직사각형에 나노 크기의 이산화티타늄 기둥들이 가득 박힌 평평한 유리 표면인 메타렌즈 배열을 설계했다. 이 기둥들은 각각 특정한 방법으로 빛을 조작하기 위해 정확하게 모양을 만들고 방향을 잡았다. 여기서 편광화는 중요한 역할을 했다. 나노기둥들은 왼쪽 원 편광(LCP) 또는 오른쪽 원 편광(RCP)일 경우 빛을 다른 양만큼 구부린다. 굽힘의 양이 다르면 초점이 달라지기 때문에 연구자들은 이미 효과적으로 두 개의 초점을 맞췄다.

문제는 이렇게 만들어진 단일 센서가 이 초점들 중 하나에서만 초점을 맞춘 이미지를 포착할 수 있다는 것이었다.

가깝게도 멀게도 초점을 맞추는 삼엽충의 이중 층 눈의 기능을 따라잡을 방법이 필요했다.

그래서 연구원들은 각각의 나노 기둥 메타렌즈를 배치해 각 렌즈에 들어가는 빛 중 일부는 직사각형의 긴 면을 통과하고, 일부는 더 짧은 경로를 통과하도록 했다.

이것이 빛을 두 개의 다른 양만큼 구부려 두 개의 다른 초점들을 만들었다. 하나는 매크로(접사) 렌즈처럼 가까이 초점을 맞추고, 다른 하나는 망원 렌즈처럼 먼 거리에 초점을 맞췄다. 그 결과 연구원들은 이것과 편광 사이에서 네 개의 이미지를 확보했다.

연구원들은 이어 망원 초점 광선빔의 왼쪽 원 편광판(LCP)이 매크로 초점 광선빔의 오른쪽 원 편광판(RCP)과 정확히 같은 평면에 초점을 맞추게 하는 정확한 메타렌즈 기하학을 알아냈다. 결과는 성공적이었다.

이는 그들이 단일 광시야 센서로 어떤 공간 해상도도 잃지 않고 또렷한 초점 안에서 이 두 가지를 동시에 기록할 수 있게 해 주었다.

근초점 3cm, 원초점 1.7km에 설정된 성공적 39⨯39 메타렌즈 성공

연구팀은 39⨯39 메타렌즈 어레이를 설계하고 제작했는데, 근초점은 3cm에, 원초점은 1.7km에 설정됐다.

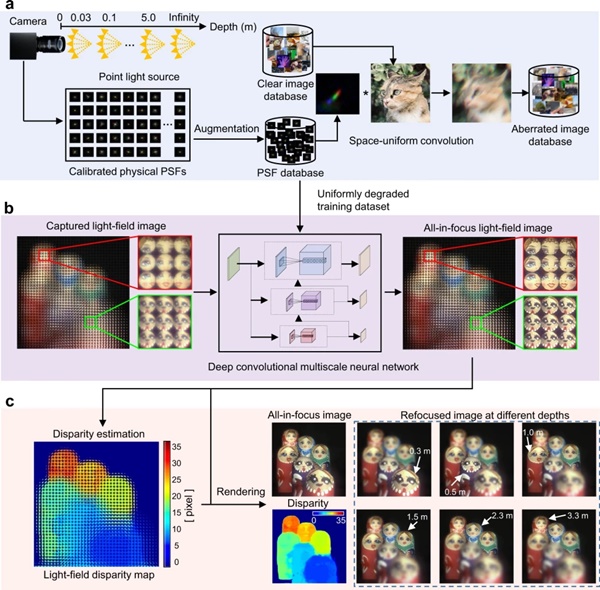

이들은 나노미터급의 정밀성을 요하는 렌즈 제작에서 가장 어려운 엄격한 제조공차(오차허용도)를 유지하기 위해 이 과정에 인공지능(AI) 훈련법을 사용했다.

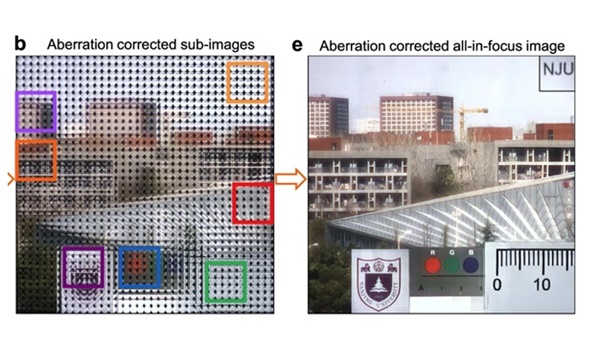

즉, 1521개의 작은 이중 목적 메타렌즈에 의해 발생하는 많은 이상(aberrations)들을 교정하기 위해 다중 축척(multi-scale) 컨볼루션 신경망(합성곱 신경망(Convolutional Neural Network·CNN)을 이용한 재구성 알고리즘을 설계하고 코드화했다. (*CNN은 인공신경망에 필터링 기법을 적용해 이미지를 효과적으로 처리할 수 있는 심층 신경망 기법이며, 행렬로 표현된 필터의 각 요소가 데이터 처리에 적합하도록 자동 학습 과정을 통해 이미지를 분류하는 기법이다.)

간단한 보정 프로세스와 교육 세션 후에, 이 렌즈는 색 수차, 흐릿함, 그리고 다른 광학 결함의 관점에서, 특정 메타렌즈 어레이가 어디에서 어떻게 (완벽성에서) 이탈하는지 정확히 알아낼 수 있고, 어떤 촬영된 이미지에도 쉽게 적용될 수 있는 수정을 할 수 있게 됐다.

게다가 그것의 두 초점은 1.6km 이상 떨어져 있지만, 재구성 알고리즘은 그들 사이에 놓여진 어떤 대상도 또렷하게 재구성한다. 이는 지금까지 보여진 그 어느 이미지보다도 깊는 시야계 심도를 갖는 최종 이미지를 만든다. 여기서 렌즈로부터 1.5인치 떨어져 있는 물체들은 초자연적으로 선명하고 또렷하다.

실제로 이 재구성 알고리즘은 오류 수정에 뛰어난 성능을 보이기에 연구팀은 이 기술을 사용하는 광시야 카메라가 극단적으로 정밀하게 제작될 필요가 없을 것이라고 말한다. 즉, 이 방식이 고성능임에도 제작을 비교적 용이하게 해 줄 것이란 게 연구팀의 생각이다.

네이처 커뮤니케이션즈에 게재된 연구 논문은 놈내용은 “생체에서 영감을 받은 이 나노광(nanophotonic) 광시야 카메라는 컴퓨팅 후처리와 함께 최고의 피사계심도(DoF)를 가진 풀컬러 이미징을 달성할 수 있을 뿐만 아니라, 메타 광학에 의해 유도되는 광학적 이상도 제거할 수 있다”고 요약하고 있다.

연구팀은 이 기술이 소비자 사진 촬영, 광학 현미경 검사, 머신 비전 등의 분야에서 유용할 수 있다고 믿고 있다. 하지만, 현 시점에서는 상당히 새로운 연구이기 때문에 출시까지는 다소 시간이 걸릴 것으로 보인다.

이 연구 내용은 네이처 커뮤니케이션즈(Nature Communications) 4월 19일자에 공개됐다.

소셜댓글